時間がとまっているのはワシやったorz

たぶん、以下のスライドの説明で思考停止している人が、いけしゃぁしゃぁと騙っているのが現状のように思えました。実際にはもう少し話は進んでいます。

・OZの魔法使いでカーテンの手前に見えるもの(=ラピュタの上層)

プロンプトの書き方次第で任意のタスクを遂行させることができる=優勝!?

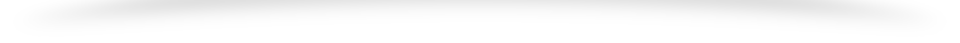

さらに以下のスライドと、もう一つ、大事な注釈が口頭で説明されていた気がします。

・OZの魔法使いのカーテンの裏に隠れているものの推測(=ラピュタの黒い半球体)

ごみための予想:膨大なswitch~caseでお茶を濁した外注プログラマが失踪した?

InstructGPTの先、についてはだれも(OpenAIの)中の人を除く)、知らないということです。

幸いにして、競合の大手が似た仕組みで似た感じのものを実現できているので、およそのからくりは見えていそうではありますが。

あとは、モデル自体がモデルを改良し始めるポジティブフィードバックが始まるタイミングですね。

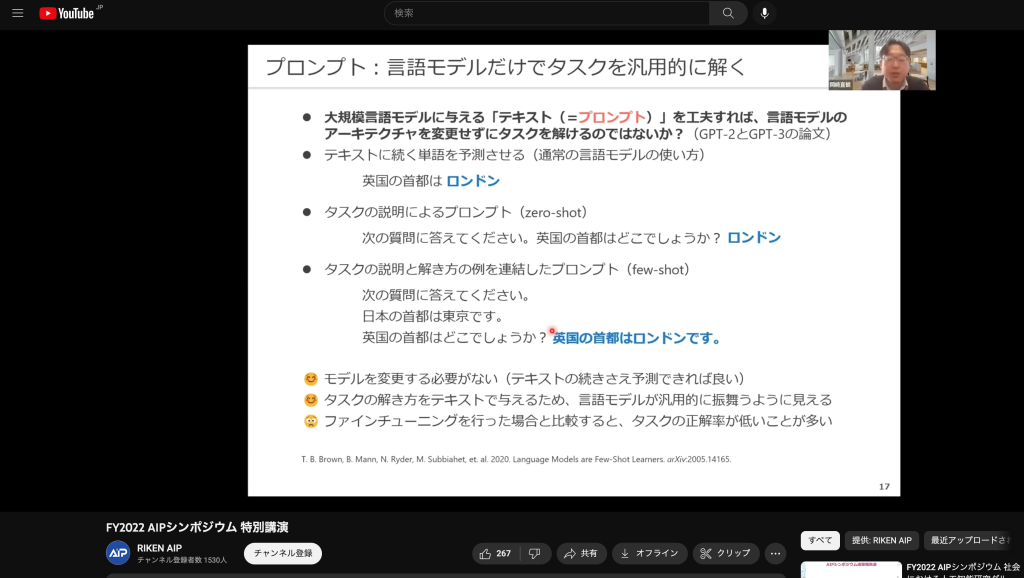

そんなことを考えながら、昔買ったNLU本の2周目をGWの酒の肴にするごみためまんなのでしたぁ。

Amazon | Natural Language Understanding | Allen, James | Theory of Computing

(余禄菩薩)

大規模言語モデルが獲得したという「ナマモノ共通の言語の抽象化モデル」がモノホンなら、シン・バウリンガルがあっさり実現できるっていう話も興味深いです。

ごみための予想:「・腹減った・お前うまそうだな・暇~・背中かゆい」しか言ってない説

最近知ったことですが、飼い猫のにゃぁにゃぁって、野良猫は使わないらしいですね。つまり飼い猫は、インゲンの声を真似して「しゃべっているつもり」ということですか。